Non ci sono prodotti a carrello.

Anche quest’anno, nella ormai tradizionale struttura CP-25 della Central Plaza, NXP Semiconductors ha messo in mostra numerose demo dando la possibilità a Clienti, visitatori professionali o semplici curiosi, di vedere cosa è possibile realizzare con i prodotti hardware e software che NXP mette a disposizioni di OEM e progettisti.

Quest’anno i visitatori sono stati accolti da due autovetture a guida autonoma di AutonomouStuff, società specializzata nella vendita e integrazione di prodotti ADAS in normali vetture di serie. I due prototipi utilizzavano l’NXP Automated Drive Kit, un kit basato sul BlueBox NXPBLBX2, il sistema computerizzato prodotto da NXP in grado di gestire sensori di vario tipo, acquisire ed elaborare i dati e interfacciarsi al sistema di guida della vettura.

BlueBox utilizza un processore S32V234 per la visione e per applicazioni di sensor fusion nonché un processore embedded LS2085A con una capacità di 90.000 DMIPS.

Questo prodotto è anche al centro dell’accordo tra NXP e Baidu per l’Apollo Open Autonomous Driving Platform; per questa iniziativa NXP fornirà anche radar a onde millimetriche, V2X, sicurezza e connettività intelligente.

Annunciata per la prima volta ad aprile 2017, Apollo è la piattaforma di guida autonoma aperta di Baidu che fornisce una soluzione completa, sicura e affidabile e che supporta tutte le principali caratteristiche e funzioni di un veicolo autonomo. Secondo Baidu, Apollo rappresenta l’Android dell’industria automobilistica autonoma, ma ancora più aperto e più potente, che consentirà ai partner di progetto (oltre 70) di avviare rapidamente la produzione di veicoli autonomi.

In dettaglio, la collaborazione prevede la fornitura da parte di NXP di prodotti e soluzioni per guida autonoma, radar a onde millimetriche, V2X, sicurezza e connettività intelligente; i partner sfrutteranno i bassi consumi energetici, le prestazioni e la sicurezza funzionale della piattaforma di sviluppo BlueBox di NXP, con Baidu che collaborerà all’integrazione dei sensori e ai processori ad alte prestazioni per reti di deep learning; inoltre il sistema in-car di Baidu, DuerOS per Apollo, integrerà le soluzioni di infotainment NXP per accelerare il time-to-market e migliorare le prestazioni.

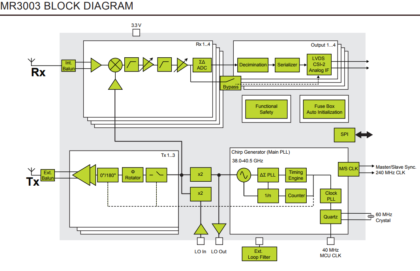

Sempre in ambito automotive, Il CES è stata l’occasione per vedere dal vivo l’ultimo nato nel campo dei ricetrasmettitori radar a 77 GHz, il modello MR3003. Questo prodotto è stato specificamente sviluppato per applicazioni radar frontali o angolari nella guida automatizzata, dove sono richieste funzionalità ad alta risoluzione e a lungo raggio.

L’aumento della domanda sia per la vista frontale che per il rilevamento della visione surround a 360 gradi ha portato i produttori automobilistici a cercare le migliori prestazioni RF, il consumo energetico più basso e le dimensioni più ridotte, in base alle specifiche dell’applicazione e alla posizione all’interno del veicolo.

NXP è l’unica società a disporre di una completa gamma di ricetrasmettitori radar basata sulle tecnologie di processo BiCMOS e Advanced RFCMOS, per soddisfare le esigenze delle Case Automobilistici con una soluzione di sistema completa. Unitamente alla piattaforma di elaborazione radar per autoveicoli NXP S32R, ai circuiti integrati di rete e alle soluzioni di gestione dell’alimentazione, il portafoglio radar NXP consente alle Case Automobilistiche di sviluppare sistemi che vanno dai piccoli sensori radar, alle applicazioni di rilevamento di immagini ad alta risoluzione, consentendo un’ampia penetrazione del radar su tutta la gamma di modelli di auto. Si stima che oltre il 50 percento di tutti i moduli radar per auto spediti nel 2017 abbia utilizzato la tecnologia radar NXP2.

Utilizzando più ricetrasmettitori radar MR3003 collegati all’interno di un singolo sensore radar è possibile ottenere un’elevata potenza di uscita nonché bassa rumorosità e scalabilità, necessarie per ottenere un rilevamento radar ad alta risoluzione. Capace di tracciare migliaia di obiettivi simultaneamente, questo scenario radar consente il rilevamento in tempo reale dell’ambiente circostante, essenziale per la guida autonoma di livello 4 e di livello 5.

Sempre in campo automobilistico, durante il CES è stata annunciata la collaborazione strategica tra NXP, LG Electronics e HELLA Aglaia nel campo della visione per applicazione automobilistiche.

Le tre società hanno creato una nuova piattaforma di visione che sarà messa a disposizione di tutte le case automobilistiche per promuovere il rilevamento e la classificazione best-in-class degli utenti della strada, e non solo. La nuova piattaforma di visione si rivolge agli OEM alle prese con piattaforme di visione automobilistica proprietarie, molto rigide e che offrono poco spazio alle Case Automobilistiche per differenziarsi nel mercato globale. Il lavoro di sviluppo congiunto, guidato da LG Electronics, si basa sulla convinzione che le piattaforme di visione devono essere aperte e sicure per soddisfare le linee guida NCAP e aprire la strada alla guida automatizzata di livello da 3 a 5.

Il sistema di visione basato su telecamera, sviluppato da LG Electronics insieme a NXP e HELLA Aglaia, è studiato per rilevare e classificare gli utenti della strada “vulnerabili” come pedoni e ciclisti, e attivare la frenata di emergenza automatica (AEB). Queste telecamere possono essere fissate al parabrezza, dietro lo specchietto retrovisore. Il sistema è in grado anche di rilevare i segnali stradali, informare il conducente dei limiti di velocità, monitorare la tenuta della corsia e facilitare la correzione dello sterzo; l’IP di elaborazione della visione di NXP, unitamente alle competenze nel campo degli algoritmi di HELLA Aglaia e LG, consentono a tali applicazioni di funzionare a bassissima latenza occupando uno spazio limitato.

La piattaforma di visione aprirà anche la strada a nuove funzionalità avanzate per aumentare le attività di guida autonoma e le reti di Intelligenza Artificiale.

La capacità di elaborazione della visione di NXP, insieme all’elevata sicurezza e alla qualità del design ne fanno una soluzione ideale nell’ambito della visione per auto.

La famiglia di processori di visione S32V offre potenti GPU per l’elaborazione di immagini, capacità di funzionamento offline, e apprendimento automatico per i motori APEX-D. Tutto ciò offre ai produttori di automobili e ai fornitori un’opportunità per ridurre le vittime della strada implementando algoritmi di rilevamento avanzati su una piattaforma certificata ISO26262. Le piattaforme SoC di NXP sono basate su standard software aperti per consentire ai fornitori e agli OEM di attuare le loro tecnologie di differenziazione in ambito ADAS.

Edge Computing

Più che mai, in questa occasione, NXP ha spinto sulla strada dell’Edge Computing, presentando numerose demo dove questo concetto è stato implementato.

Negli ultimi anni, il cloud computing ha creato nuovi paradigmi di elaborazione basati sulla virtualizzazione, su sistemi massivi di elaborazione e modelli di servizi su piattaforma. Il cloud offre grandi vantaggi quando i carichi di lavoro non sono eccessivamente sensibili alla latenza della rete o alla larghezza di banda. Ad esempio nelle applicazioni in cui gli esseri umani sono direttamente coinvolti, come negli smartphone, tablet e PC; in questi casi i leggeri ritardi e le limitazioni di banda non vengono percepiti. Per le applicazioni che richiedono risposte in tempo (quasi) reale, dell’ordine del millisecondo, come nei sistemi di guida autonoma, o nel caso di enormi quantità di dati come nell’elaborazione video, non è possibile basarsi unicamente sul cloud computing, ma bisogna spostare in modo selettivo l’elaborazione dai data center cloud alle piattaforme di elaborazione edge e end node.

L’Edge computing è un concetto sviluppato da diversi anni per supportare le distribuzioni IoT: si differenzia dai tradizionali sistemi embedded in quanto imita i modelli di agile software dei sistemi cloud. L’Edge computing sfrutta la virtualizzazione e le applicazioni all’interno di un container software, applicazioni che possono essere continuamente aggiornate; questa tecnologia sta rivoluzionando il modo in cui i sistemi embedded sono progettati, proponendo sistemi realmente distribuiti.

Non solo. Gli ultimi anni hanno visto un rapido aumento dell’uso del machine learning (ML) come tecnologia per supportare carichi di lavoro di intelligenza artificiale. Mentre il cloud rimarrà il posto migliore per addestrare gli algoritmi ML, i dispositivi Edge diventano sempre più il posto migliore per eseguire la componente di inferenza di ML e abilitare l’intelligenza artificiale per intere nuove classi di sistemi con i risultati della formazione ML che possono essere eseguiti in modo molto efficiente su processori multicore Arm.

Le prestazioni efficienti dal punto di vista energetico dei SoC multicore Arm Cortex-A53 e A72, assistiti da GPU locali o motori di elaborazione vettoriale, rendono le offerte SoC di NXP la scelta migliore per eseguire le librerie di software open source più popolari per l’apprendimento automatico.

Gli algoritmi di visione artificiale in esecuzione su nodi Edge supportano l’estrazione e la trasmissione di dati semantici anziché l’invio di flussi video non elaborati, consentendo un uso più ampio della tecnologia video e di imaging offline.

Da questo punto di vista, NXP offre la più ampia gamma di processori per Edge Computing, dal sub-1Watt single-core, LS1012A al recentissimo 16-core LX2160A. NXP offre anche AWS Greengrass in esecuzione su tutti i suoi processori Layerscape, tutti dotati dell’architettura NXP per la sicurezza dei dispositivi IoT per tutto il loro ciclo di vita: produzione, messa in servizio, distribuzione, aggiornamento e dismissione. Ogni processore dispone di un ID univoco, archiviazione sicura su chip, insieme all’avvio sicuro e all’aggiornamento software remoto.

Tutte queste tecnologie – edge computing, visione artificiale e machine learning – erano integrate in alcune applicazioni di Smart Home, più precisamente in sistemi di cottura a microonde in grado di riconoscere i cibi introdotti e calcolare il tempo di cottura ottimale.

Sempre nell’ambito dei sistemi di Smart Home, NXP ha presentato un prototipo del suo Smart Defrost per uno scongelamento rapido, sicuro e di qualità. Di questo innovativo prodotto ci siamo già occupati alcuni giorni fa.

Questa soluzione, che utilizza la tecnologia RF allo stato solido, affronta il problema dello sbrinamento rapido e sicuro degli alimenti congelati, anche al fine di ridurre gli sprechi alimentari, preservando nel contempo le caratteristiche nutrizionali e l’umidità dell’alimento. Con questa soluzione è possibile scongelare carne, pesce, frutta o verdura in pochi minuti. Anche in questo caso il software esegue il monitoraggio e la regolazione in tempo reale durante l’intero processo di scongelamento, contribuendo a garantire un trasferimento di energia efficiente ed efficace durante l’intero ciclo, poiché le proprietà del cibo cambiano al variare della temperatura.

Un’altra interessante applicazione proposta al CES in ambito IoT/Edge Computing riguardava un sistema di controllo delle spedizioni. In pratica una minuscola board autoalimentata in grado di memorizzare schock meccanici, termici, ecc. subiti dal pacco durante il viaggio, e di inviare un report con i dati già elaborati localmente sul cloud al termine del viaggio.

Per quanto riguarda la tecnologia NFC (Near Field Communications), NXP ha presentato – in collaborazione con Hasbro e Harmonix – il gioco DROPMIX, un frenetico gioco di mixaggio musicale che consente ai giocatori di creare mix con canzoni di successo giocando schede abilitate con chip NFC su una console di gioco collegata a un’app mobile gratuita. Il gioco introduce un nuovo modo per raccogliere, scoprire e combinare i brani musicali preferiti utilizzando queste schede; la soluzione NFC end-to-end completa di NXP composta sia dal lettore NFC sia dai chip al centro dell’abilitazione del gioco, garantisce che le carte possano essere letti rapidamente e in modo affidabile.

Questo nuovo caso di utilizzo della tecnologia NFC rafforza l’ambizione di NXP di portare NFC ovunque, un modo semplice ed economico per portare nuovi servizi, accessori ed esperienze in qualsiasi prodotto.

Numerose anche le applicazioni proposte con i processori di applicazioni i.MX 8M che dispongono di funzionalità multimediali all’avanguardia. Questa piattaforma è stata sviluppata da NXP Semiconductors per affrontare la convergenza di esperienze sensoriali immersive alimentate da richieste vocali, video e audio.

I processori NXP i.MX 8M soddisfano i requisiti dei progettisti per una piattaforma che combina A/V e apprendimento automatico per creare prodotti connessi che possono essere controllati tramite comando vocale. I chip forniscono la tecnologia di processo e le esigenze di elaborazione per gestire e ridurre il tempo di risposta dei comandi dei dispositivi smart connessi. Questa famiglia di processori è ideale anche per la gestione di illuminazione, termostati, serrature, sicurezza domestica, sprinkler intelligenti, altri sistemi e dispositivi per un ambiente domestico più intuitivo e reattivo.

Allo stand di NXP abbiamo anche visto all’opera un robot in grado di disegnare, una mano robotica che utilizza TensorFlow per giocare alla morra, differenti soluzioni di speech recognition e IA basate su Alexa e uno smart TV 4K HDR, doppio schermo con un elevato livello di interattività.